# KubeDoor

**Repository Path**: jinops/KubeDoor

## Basic Information

- **Project Name**: KubeDoor

- **Description**: No description available

- **Primary Language**: Unknown

- **License**: Apache-2.0

- **Default Branch**: main

- **Homepage**: None

- **GVP Project**: No

## Statistics

- **Stars**: 0

- **Forks**: 12

- **Created**: 2025-01-27

- **Last Updated**: 2025-09-17

## Categories & Tags

**Categories**: Uncategorized

**Tags**: None

## README

[](https://starsl.cn)

[](https://github.com/CassInfra/KubeDoor/commits/main)

[](https://github.com/CassInfra/KubeDoor/issues)

[](https://nodejs.org)

[](https://nodejs.org)

[](https://github.com/CassInfra/KubeDoor/blob/main/LICENSE)

[](https://www.murphysec.com/dr/Zoyt5g0huRavAtItj2)

# 花折 - KubeDoor

花开堪折直须折🌻莫待无花空折枝

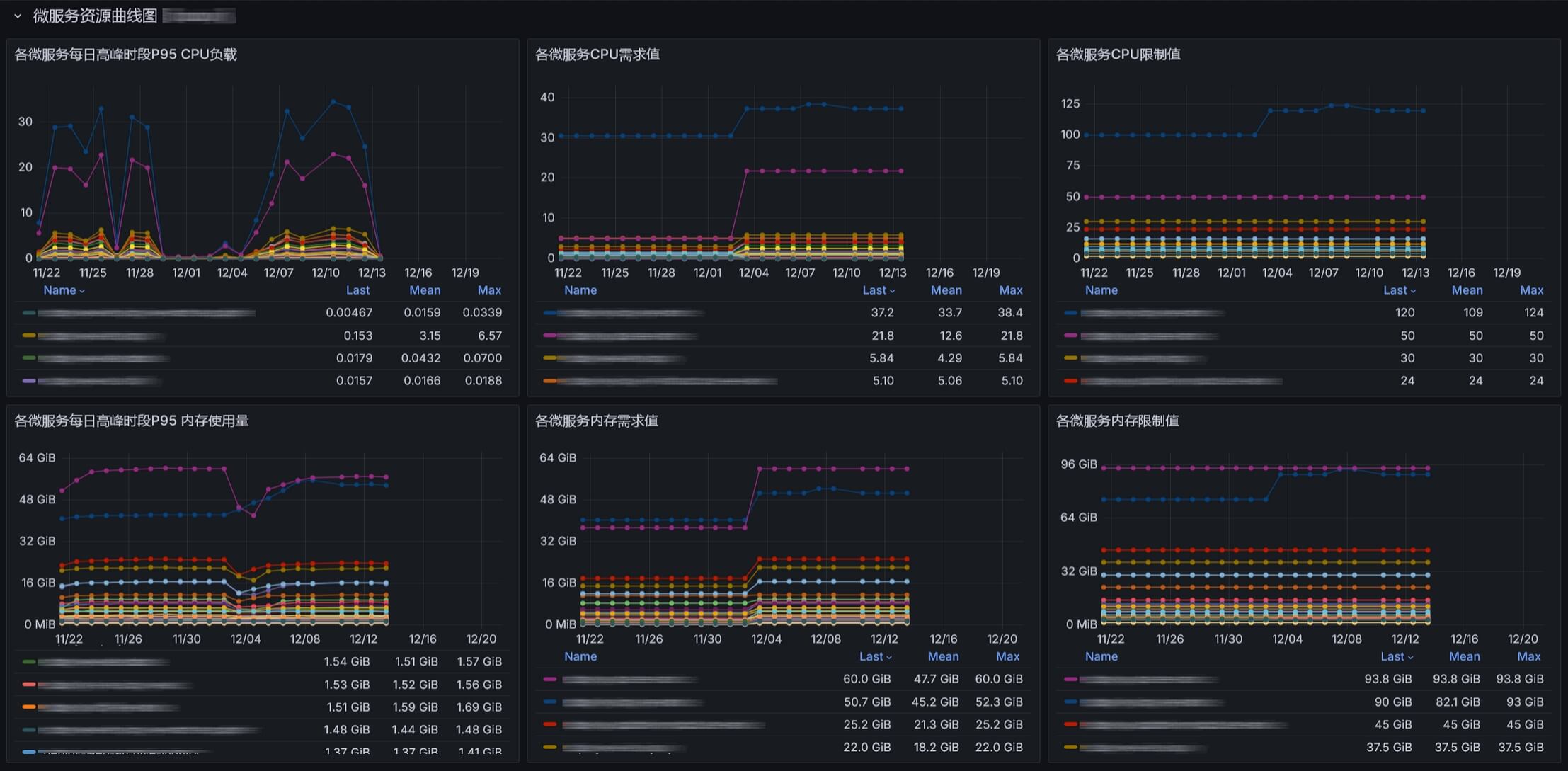

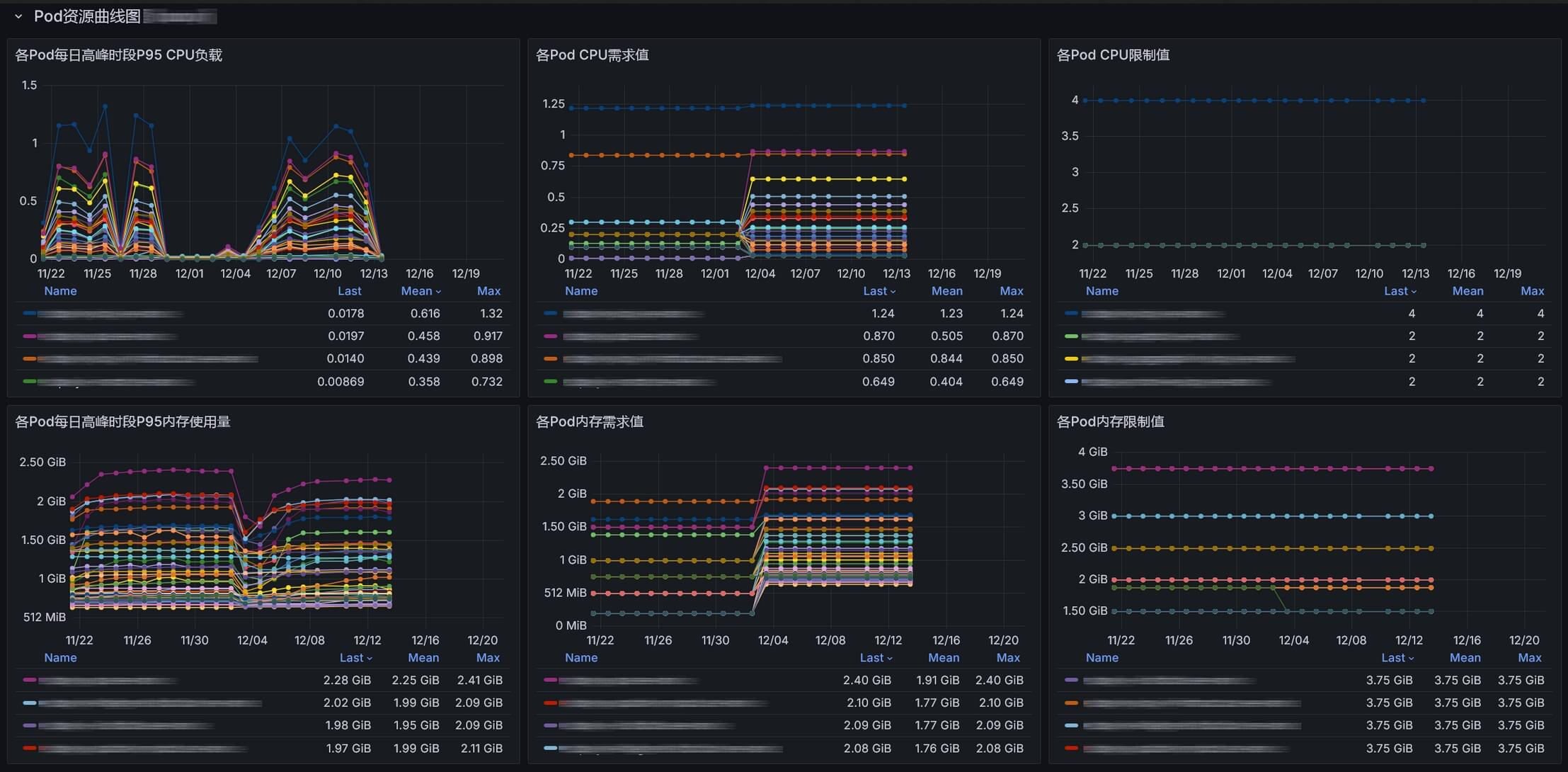

### 🦄开思 开源第一弹:**基于AI推荐+专家经验的K8S负载感知调度与容量管控系统**

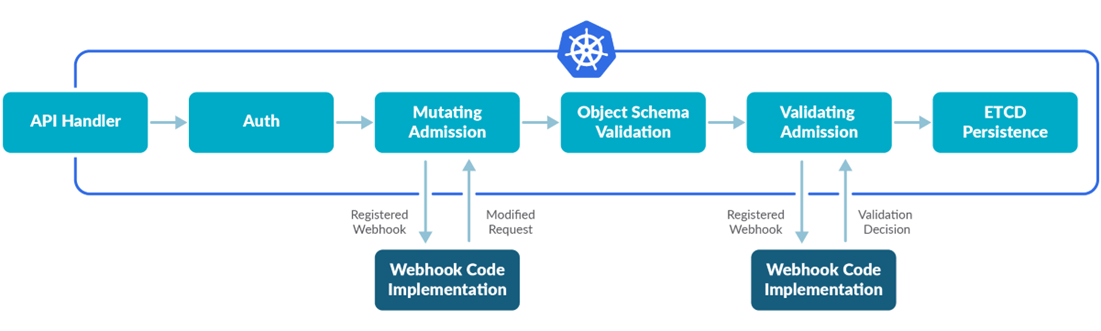

**K8S准入控制逻辑**

#### 如果觉得项目不错,麻烦动动小手点个⭐️Star⭐️ 如果你还有其他想法或者需求,欢迎在 issue 中交流

---

## 🎯2025 KubeDoor RoadMap

- **[📅KubeDoor 项目进度](https://github.com/orgs/CassInfra/projects/1/views/1)**

- 🥇多K8S支持:在统一的WebUI对多K8S做管控和资源分析展示。

- 🥈英文版发布

- 🥉集成K8S实时监控能力,实现一键部署,整合K8S实时资源看板,接入K8S异常AI分析能力。

- 🏅微服务AI评分:根据资源使用情况,发现资源浪费的问题,结合AI缩容,降本增效,做AI综合评分。

- 🏅微服务AI缩容:基于微服务高峰期的资源信息,对接AI分析与专家经验,计算微服务Pod数是否合理,生成缩容指令与统计。

- 🏅根据K8S节点资源使用率做节点管控与调度分析

- 🚩采集更多的微服务资源信息: QPS/JVM/GC

- 🚩针对微服务Pod做精细化操作:隔离、删除、dump、jstack、jfr、jvm

---

## 🚀部署说明

#### 0. 需要已有 Prometheus监控K8S

需要有`cadvisor`和`kube-state-metrics`这2个JOB,才能采集到K8S的以下指标

- `container_cpu_usage_seconds_total`

- `container_memory_working_set_bytes`

- `container_spec_cpu_quota`

- `kube_pod_container_info`

- `kube_pod_container_resource_limits`

- `kube_pod_container_resource_requests`

#### 1. 部署 Cert-manager

用于K8S Mutating Webhook的强制https认证

```

kubectl apply -f https://StarsL.cn/kubedoor/00.cert-manager_v1.16.2_cn.yaml

```

#### 2. 部署 ClickHouse 并初始化

用于存储采集的指标数据与微服务的资源信息

```bash

# 默认使用docker compose运行,部署在/opt/clickhouse目录下。

curl -s https://StarsL.cn/kubedoor/install-clickhouse.sh|sudo bash

# 启动ClickHouse(启动后会自动初始化表结构)

cd /opt/clickhouse && docker compose up -d

```

如果已有ClickHouse,请逐条执行以下SQL,完成初始化表结构

```bash

https://StarsL.cn/kubedoor/kubedoor-init.sql

```

#### 3. 部署KubeDoor

```bash

wget https://StarsL.cn/kubedoor/kubedoor-0.2.1.tgz

tar -zxvf kubedoor.tgz

# 编辑values.yaml文件,请仔细阅读注释,根据描述修改配置内容。

vim kubedoor/values.yaml

# 使用helm安装(注意在kubedoor目录外执行。)

helm install kubedoor ./kubedoor

# 安装完成后,所有资源都会部署在kubedoor命名空间。

```

#### 4. 访问WebUI 并初始化数据

1. 使用K8S节点IP + kubedoor-web的NodePort访问,默认账号密码都是 **`kubedoor`**

2. 点击`配置中心`,输入需要采集的历史数据时长,点击`采集并更新`,即可采集历史数据并更新高峰时段数据到管控表。

>**默认会从Prometheus采集10天数据(建议采集1个月),并将10天内最大资源消耗日的数据写入到管控表,如果耗时较长,请等待采集完成或缩短采集时长。重复执行`采集并更新`不会导致重复写入数据,请放心使用,每次采集后都会自动将10天内最大资源消耗日的数据写入到管控表。**

3. 点击`管控状态`的开关,显示`管控已启用`,表示已开启。

---

## ⛔注意事项

- 部署完成后,**默认不会开启管控机制**,你可以按上述操作通过WebUI 来开关管控能力。特殊情况下,你也可以使用`kubectl`来开关管控功能:

```bash

# 开启管控

kubectl apply -f https://StarsL.cn/kubedoor/99.kubedoor-Mutating.yaml

# 关闭管控

kubectl delete mutatingwebhookconfigurations kubedoor-webhook-configuration

```

- **开启管控机制后**,目前只会拦截**deployment的创建,更新,扩缩容**操作;管控**pod数,需求值,限制值**。不会控制其它操作和属性。

- **开启管控机制后**,通过任何方式对Deployment执行扩缩容或者更新操作都会受到管控。

- **开启管控机制后**,扩缩容或者重启Deployment时,Pod数优先取`指定Pod`字段,若该字段为-1,则取`当日Pod`字段。

## 🌰管控例子

- 你通过Kubectl对一个Deployment执行了扩容10个Pod后,**会触发拦截机制**,到数据库中去查询该微服务的Pod,然后使用该值来进行实际的扩缩容。(正确的做法应该是在KubeDoor-Web来执行扩缩容操作。)

- 你通过某发布系统修改了Deployment的镜像版本,执行发布操作,**会触发拦截机制**,到数据库中去查询该微服务的Pod数,需求值,限制值,然后使用这些值值以及新的镜像来进行实际的更新操作。

## 🚩管控原则

- **你对deployment的操作不会触发deployment重启的,也没有修改Pod数的:** 触发管控拦截后,只会按照你的操作来更新deployment(不会重启Deployment)

- **你对deployment的操作不会触发deployment重启的,并且修改Pod数的:** 触发管控拦截后,Pod数会根据数据库的值以及你修改的其它信息来更新Deployment。(不会重启Deployment)

- **你对deployment的操作会触发deployment重启的:** 触发管控拦截后,会到数据库中去查询该微服务的Pod数,需求值,限制值,然后使用这些值以及你修改的其它信息来更新Deployment。(会重启Deployment)

---

## 🔔KubeDoor交流群与🧧赞赏

## 🙇贡献者

## ⭐STAR History

[](https://github.com/CassInfra/KubeDoor)

## 🥰鸣谢

感谢如下优秀的项目,没有这些项目,不可能会有**KubeDoor**:

- 后端技术栈

- [Flask](https://flask.palletsprojects.com)

- [Grafana](https://grafana.com/)

- [Nginx](https://nginx.org/)

- 前端技术栈

- [Vue](https://vuejs.org/)

- [Element Plus](https://element-plus.org)

- [pure-admin](https://pure-admin.cn/)

- **特别鸣谢**

- [CassTime](https://www.casstime.com):**KubeDoor**的诞生离不开🦄**开思**的支持。